Bạn có biết rằng gần một nửa lượng truy cập vào website mỗi ngày không phải đến từ con người thật sự? Nếu bạn chạy quảng cáo, chi phí ngày càng tăng nhưng chuyển đổi không cải thiện hoặc báo cáo traffic đẹp nhưng doanh thu thực tế không tương xứng, đó có thể là dấu hiệu của bot traffic. Tuy nhiên, không phải traffic bot nào cũng xấu. Một số bot giúp website được lập chỉ mục nhanh hơn, trong khi những bot khác có thể gây hại nghiêm trọng cho hệ thống. Vậy thực sự bot traffic là gì? Làm thế nào để phân loại bot tốt, bot xấu và bot trung lập, cũng như nhận diện và kiểm soát chúng? Bài viết này sẽ giải đáp tất cả, giúp bạn bảo vệ dữ liệu, ngân sách và tối ưu hiệu quả SEO một cách chủ động.

- Bot traffic là gì?

- Các loại bot traffic phổ biến hiện nay

- Bot traffic hoạt động như thế nào?

- Hai mặt đối lập của bot traffic trong cuộc chơi SEO

- Cách nhận biết website đang bị tấn công bởi traffic bot xấu

- Hướng dẫn kiểm tra bot traffic chính xác

- Giải pháp quản lý và ngăn chặn bot traffic hiệu quả

- Một số câu hỏi thường gặp về lưu lượng truy cập bot

- 1. Bot traffic có làm tăng thứ hạng SEO cho website không?

- 2. Làm thế nào để phân biệt người dùng thật và bot trên Google Analytics 4 (GA4)?

- 3. Có nên chặn hoàn toàn bot traffic không?

- 4. Tại sao website mới lập, chưa có nội dung lại được nhiều bot truy cập?

- 5. File Robots.txt có ngăn chặn được 100% bot traffic xấu không?

- 6. Bot traffic có phải là traffic ảo không? Khoảng bao nhiêu % bot traffic là bình thường?

Bot traffic là gì?

Bot traffic là lưu lượng truy cập đến website được tạo ra bởi các chương trình tự động (bot) thay vì người dùng thực. Những bot này có thể được lập trình để thực hiện nhiều hành vi khác nhau như thu thập dữ liệu, kiểm tra trạng thái website hoặc thậm chí tấn công hệ thống.

Điểm đặc biệt của bot traffic là chúng có thể hoạt động liên tục 24/7 với tốc độ và quy mô mà con người không thể đạt được. Điều này khiến chúng vừa trở thành công cụ hữu ích, vừa là mối đe dọa tiềm ẩn nếu không được kiểm soát đúng cách. Bot traffic có thể chiếm một tỷ lệ đáng kể trong tổng lượng truy cập website, đặc biệt với các trang có lượng traffic lớn. Vì vậy, hiểu đúng về bot traffic là bước đầu tiên để đọc chính xác dữ liệu và tối ưu hiệu suất vận hành.

Các loại bot traffic phổ biến hiện nay

Không phải tất cả các loại bot traffic đều giống nhau. Việc phân loại bot traffic giúp bạn hiểu rõ mục đích hoạt động của từng nhóm, từ đó đưa ra chiến lược kiểm soát phù hợp thay vì chặn tất cả một cách mù quáng. Dưới đây là 3 nhóm bot traffic phổ biến nhất:

1. Bot tốt (Good bots)

Bot tốt là các chương trình tự động được xây dựng và vận hành bởi các tổ chức, công ty uy tín với mục đích hợp pháp, mang lại giá trị cho cả người dùng lẫn chủ sở hữu website. Chúng thường công khai danh tính qua User-Agent và tuân thủ các quy tắc trong robots.txt. Nếu bạn chặn nhầm bot tốt có thể gây hậu quả ngược, ảnh hưởng đến SEO hoặc làm gián đoạn hệ thống giám sát website. Bạn cần nhận diện rõ các bot lưu lượng truy cập này để tránh nhầm lẫn với các bot giả mạo.

Search Engine Bots (Bot công cụ tìm kiếm)

Đây là nhóm bot quan trọng nhất mà bất kỳ website nào cũng cần chào đón. Search engine bots, còn gọi là web crawlers hoặc spiders được triển khai bởi các công cụ tìm kiếm như Google, Bing, Yandex hay Baidu để thu thập dữ liệu và lập chỉ mục nội dung website.

Cách hoạt động khá đơn giản: bot xuất phát từ danh sách URL đã biết, truy cập từng trang, đọc nội dung HTML, theo dõi liên kết nội bộ và ngoại bộ, rồi gửi dữ liệu về máy chủ công cụ tìm kiếm để phân tích và xếp hạng. Nhờ có chúng, website của bạn mới được hiển thị đúng cách trên kết quả tìm kiếm.

Các bot tiêu biểu:

- Googlebot - Bot của Google, thường xuyên nhất và quan trọng nhất.

- Bingbot - Bot của Microsoft Bing.

- Slurp Bot - Bot của Yahoo.

- Yandex Bot - Bot của công cụ tìm kiếm Nga Yandex.

- Baiduspider - Bot của Baidu (thị trường Trung Quốc).

Monitoring Bots (Bots giám sát)

Monitoring bots được thiết kế để liên tục kiểm tra tình trạng hoạt động của website và cơ sở hạ tầng kỹ thuật. Chúng định kỳ gửi request đến website của bạn thường từ vài phút đến vài giờ một lần để xác nhận website có đang hoạt động bình thường hay không, thời gian phản hồi có trong ngưỡng chấp nhận hay không và các dịch vụ phụ trợ (API, database, CDN) có ổn định không.

Các bot và dịch vụ tiêu biểu:

- UptimeRobot Bot dùng kiểm tra thời gian uptime và gửi cảnh báo khi website down.

- Pingdom Bot giám sát hiệu suất và tốc độ tải trang.

- New Relic Synthetics kiểm tra giao dịch và luồng người dùng tổng hợp.

- Datadog Synthetics giám sát API và trải nghiệm người dùng mô phỏng.

- StatusCake Bot kiểm tra uptime từ nhiều vị trí địa lý khác nhau.

Feed Bots (Bots đọc RSS/Atom Feed)

Feed bots là các chương trình tự động đọc và tổng hợp nội dung từ các feed RSS hoặc Atom mà website của bạn cung cấp. Chúng thường được sử dụng bởi các ứng dụng đọc tin tức (RSS readers), nền tảng tổng hợp nội dung (content aggregators) hay dịch vụ thông báo tự động.

Các bot và dịch vụ tiêu biểu:

- Feedly Bot - Dịch vụ RSS reader phổ biến với hàng triệu người dùng.

- Feedburner - Dịch vụ quản lý và phân phối RSS của Google.

- Inoreader Bot - Nền tảng đọc tin RSS chuyên nghiệp.

- NewsBlur - RSS reader với tính năng xã hội.

- Various Podcast Crawlers - Các bot của Spotify, Apple Podcasts, Google Podcasts thu thập feed podcast.

2. Bot xấu (Bad bots)

Trái ngược với bot tốt, các lưu lượng truy cập bot xấu được tạo ra với mục đích khai thác, phá hoại hoặc trục lợi từ website. Chúng thường hoạt động ẩn danh, không tuân thủ quy tắc và có thể gây ra nhiều hậu quả nghiêm trọng như tiêu tốn băng thông, đánh cắp dữ liệu hoặc làm sai lệch báo cáo phân tích. Điều nguy hiểm là hiện nay nhiều bot xấu ngày càng tinh vi, có thể giả lập hành vi người dùng thật để qua mặt hệ thống. Nếu không phát hiện kịp thời, chúng có thể khiến doanh nghiệp mất kiểm soát hoàn toàn dữ liệu. Nhóm bot xấu phổ biến bao gồm:

Web Scrapers (Bots cào nội dung)

Web scrapers là các bot được lập trình để tự động thu thập nội dung từ website mà không có sự cho phép của chủ sở hữu. Chúng "cào" (scrape) toàn bộ hoặc một phần nội dung trang như văn bản, hình ảnh, dữ liệu sản phẩm, giá cả, danh sách email rồi sử dụng cho mục đích của bên thứ ba.

Các hình thức phổ biến:

- Price Scrapers: Bot của đối thủ cạnh tranh theo dõi và sao chép bảng giá của bạn theo thời gian thực để điều chỉnh giá cạnh tranh.

- Content Scrapers: Bot sao chép toàn bộ bài viết, mô tả sản phẩm, hình ảnh để đăng lên website khác, gây hại cho SEO và bản quyền nội dung.

- Email Harvesting Bots: Bot thu thập địa chỉ email công khai trên website để bán cho danh sách spam.

- Real Estate/ Job Listing Scrapers: Các nền tảng tổng hợp trái phép lấy dữ liệu listing mà không trả phí hoặc xin phép.

Những web scrapers này thường xuất hiện với tần suất truy cập cao, pattern truy cập lặp lại nhanh chóng, đôi khi không tương tác như người dùng thật (không click, không chuyển trang theo logic). Hậu quả của việc để các web scrapers truy cập tự do là tốn băng thông và tài nguyên server, làm chậm tốc độ website và gây sai lệch dữ liệu phân tích.

Spam Bots

Spam bots nhắm vào các điểm tương tác của người dùng trên website như form liên hệ, phần bình luận, mục đăng ký để tự động điền và gửi nội dung rác hoặc liên kết độc hại với số lượng lớn.

Các hình thức phổ biến:

- Comment Spam Bots: Tự động đăng bình luận chứa liên kết đến website cần tăng backlink, thường là các trang cờ bạc, dược phẩm hoặc malware.

- Form Spam Bots: Điền và gửi form liên hệ hàng loạt với nội dung quảng cáo, lừa đảo, hoặc phishing.

- Registration Bots: Tự động tạo tài khoản giả để trục lợi hệ thống (nhận ưu đãi đăng ký, chiếm dụng username, tạo review giả).

- Vote/Poll Manipulation Bots: Thao túng kết quả bình chọn, khảo sát, hoặc hệ thống đánh giá.

Spam bots không chỉ gây phiền toái trên website mà còn để lại những hậu quả thực tế đáng kể. Nếu các liên kết spam trong bình luận không được kiểm soát kịp thời, chúng còn có thể ảnh hưởng tiêu cực đến SEO, làm giảm uy tín và thứ hạng tìm kiếm của website. Đồng thời, những bot traffic xấu này tạo ra các lead và form submission giả trong hệ thống CRM, khiến doanh nghiệp khó phân biệt giữa khách hàng thực và dữ liệu ảo, dẫn đến sai lệch trong đo lường hiệu quả marketing và lãng phí nguồn lực.

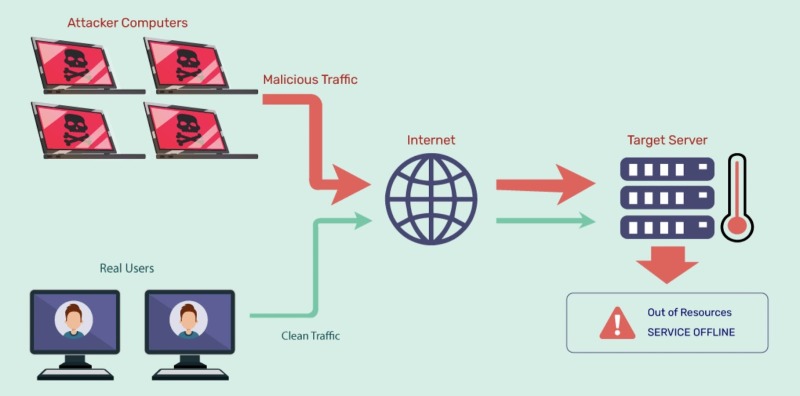

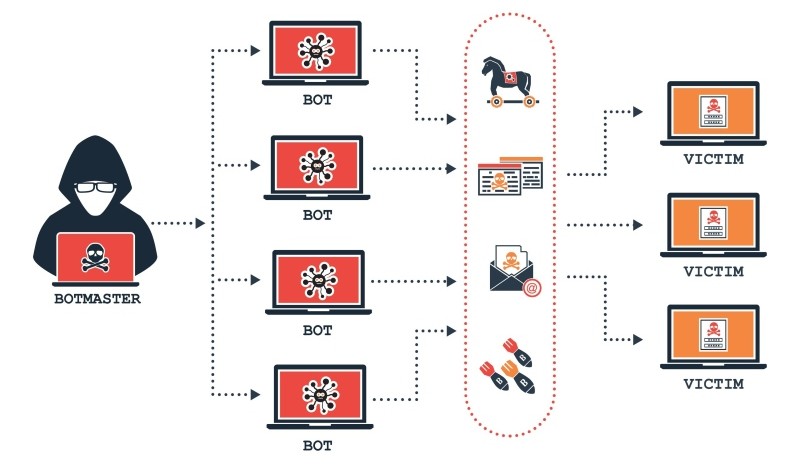

DDoS Bots

DDoS Bots được sử dụng trong các cuộc tấn công từ chối dịch vụ (DDoS) nhằm làm ngưng hoạt động hoặc làm chậm website bằng cách tạo ra lượng truy cập cực lớn trong thời gian ngắn. Chúng hoạt động bằng cách gửi hàng nghìn đến hàng triệu request đồng thời đến server, khiến hệ thống quá tải và không thể phục vụ người dùng thật. Nguồn gốc của những bot này thường đến từ một mạng lưới máy tính bị chiếm quyền điều khiển gọi là botnet, giúp kẻ tấn công triển khai cuộc tấn công ở quy mô cực lớn và khó bị phát hiện.

Các DDoS bots có thể nhắm đến nhiều loại mục tiêu khác nhau: website thương mại điện tử, ngân hàng, dịch vụ trực tuyến hoặc bất kỳ hệ thống nào có giá trị kinh doanh. Các hình thức tấn công phổ biến:

- Volumetric Attack: Áp đảo băng thông bằng lưu lượng khổng lồ (tính bằng Gbps).

- HTTP Flood: Gửi hàng triệu HTTP request hợp lệ giả để làm cạn kiệt tài nguyên server.

- Slowloris: Mở nhiều kết nối đến server và giữ chúng mở càng lâu càng tốt mà không hoàn thành request.

- Application Layer Attack (Layer 7): Tấn công nhắm vào các endpoint cụ thể tốn nhiều tài nguyên (tìm kiếm, đăng nhập, giỏ hàng).

Mục đích của chúng không chỉ là phá hoại mà còn có thể là tống tiền doanh nghiệp, làm gián đoạn dịch vụ trong các chiến dịch cạnh tranh hoặc đánh lừa hệ thống bảo mật. Hậu quả là website bị downtime, tốc độ tải trang chậm, trải nghiệm người dùng giảm sút và doanh thu trực tuyến có thể sụt giảm đáng kể.

Ad Fraud Bots

Ad Fraud Bots là loại bot gây thiệt hại tài chính trực tiếp và thầm lặng nhất đối với các doanh nghiệp chạy quảng cáo trả phí. Chúng được lập trình để giả lập hành vi người dùng thật, bao gồm xem quảng cáo, click vào banner hoặc điền form, nhằm tạo doanh thu gian lận cho các publisher độc hại hoặc phá hoại ngân sách quảng cáo của đối thủ.

Cách hoạt động của Ad Fraud Bots rất tinh vi: chúng có thể mô phỏng các thao tác click hoặc lượt xem với tần suất cao, pattern truy cập lặp lại và địa chỉ IP đa dạng, khiến các hệ thống phân tích paid traffic khó phân biệt với người dùng thật. Một số biến thể như click fraud bots hay conversion fraud bots, còn được lập trình để ẩn danh và vượt qua các cơ chế chống gian lận của nền tảng quảng cáo, gây sai lệch dữ liệu báo cáo và đánh lừa hệ thống đo lường ROI.

Theo ANA (Association of National Advertisers), gian lận quảng cáo tiêu tốn hàng chục tỷ USD mỗi năm trên toàn cầu. Hậu quả là doanh nghiệp phải trả tiền cho những lượt truy cập ảo, dữ liệu phân tích bị sai lệch, các chiến dịch marketing mất hiệu quả và tối ưu ngân sách trở nên khó khăn hơn bao giờ hết.

3. Bot trung lập

Bot trung lập là nhóm “vùng xám” trong hệ sinh thái bot. Đây là nhóm bot thường gây nhầm lẫn nhất khi phân loại vì ranh giới giữa “hợp lệ” và “đáng ngờ” không luôn rõ ràng. Chúng thường không có ý định gây hại trực tiếp, nhưng nếu không được quản lý đúng cách, hoạt động của bot traffic trung lập vẫn có thể ảnh hưởng đến hiệu suất, dữ liệu phân tích hoặc trải nghiệm người dùng của website. Một số loại bot trung lập phổ biến bao gồm:

AI Training Crawlers

Với sự bùng nổ của các mô hình AI tạo sinh, các công ty AI lớn triển khai bot để thu thập dữ liệu văn bản phục vụ việc huấn luyện mô hình ngôn ngữ. Ví dụ: GPTBot (OpenAI), ClaudeBot (Anthropic), Google-Extended (dành cho Bard/Gemini) và CCBot (Common Crawl).

Chúng không giống search engine bots, vì dữ liệu thu thập được sử dụng cho mục đích thương mại mà không trả thù lao trực tiếp cho người tạo nội dung. Tùy mục tiêu của bạn, cho phép hoặc chặn các bot này có thể ảnh hưởng đến việc nội dung được AI trích dẫn hoặc bảo vệ quyền sở hữu dữ liệu.

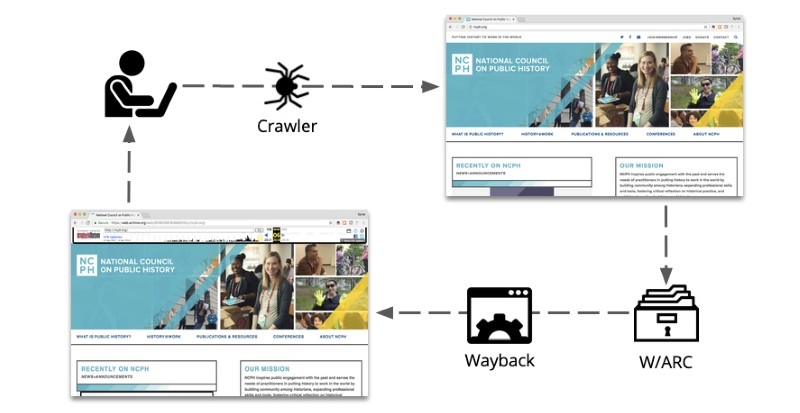

Archiving Bots

Archiving Bots là những bot được thiết kế để thu thập và lưu trữ snapshot của website, nhằm mục đích bảo tồn lịch sử internet. Điển hình là Internet Archive Bot (ia_archiver), giúp lưu trữ hàng tỷ trang web vào Wayback Machine, tạo ra một bản ghi lịch sử giá trị cho các trang web. Với hầu hết website, hoạt động của archiving bots vô hại và đôi khi còn hữu ích vì nó giúp bảo vệ nội dung khỏi bị mất, đồng thời cung cấp nguồn tham khảo lịch sử cho người dùng hoặc nhà nghiên cứu.

Tuy nhiên đối với những website chứa nội dung nhạy cảm, dữ liệu đặc thù hoặc thông tin cá nhân, cho phép archiving bots truy cập có thể là rủi ro vì dữ liệu này sẽ được lưu trữ công khai mà bạn không kiểm soát được. Do đó, các quản trị viên website có thể sử dụng robots.txt hoặc các biện pháp hạn chế truy cập để ngăn chặn bot, bảo vệ quyền riêng tư và đảm bảo dữ liệu nhạy cảm không bị lưu giữ ngoài ý muốn.

Khi một link được chia sẻ trên các nền tảng mạng xã hội như Facebook, LinkedIn hoặc Twitter/X, các lưu lượng truy cập bot của mạng xã hội sẽ truy cập URL để thu thập thông tin hiển thị preview bao gồm tiêu đề, mô tả và hình ảnh.

Các bot tiêu biểu gồm:

- Facebookexternalhit của Facebook/Meta.

- LinkedInBot

- Twitterbot.

Hoạt động này hoàn toàn hợp lệ, phục vụ trực tiếp cho việc hiển thị nội dung trên mạng xã hội, nhưng nếu link được chia sẻ rộng rãi, bot có thể tạo ra nhiều request không mong muốn và xuất hiện trong analytics như traffic không rõ nguồn gốc nếu không được phân loại đúng.

Headless Browser Bots

Đây là nhóm trung lập đáng chú ý nhất vì tính lưỡng dụng cao. Headless browsers như Chromium, Puppeteer, Playwright hay PhantomJS là trình duyệt đầy đủ tính năng nhưng không có giao diện đồ họa, điều khiển hoàn toàn bằng code.

Chúng có thể phục vụ các mục đích hợp lệ như testing tự động, kiểm tra UI/UX, performance/load testing hoặc scraping dữ liệu nội bộ nhưng cũng có thể bị sử dụng để bypass CAPTCHA, web scraping phức tạp hoặc thực hiện ad fraud tinh vi. Nhóm này khó phân biệt với người dùng thật, vì vậy việc phát hiện và quản lý đòi hỏi kỹ thuật phân tích hành vi tinh vi, không thể chỉ dựa vào User-Agent hay IP blocking.

Bot traffic hoạt động như thế nào?

Bot traffic là lưu lượng truy cập website được tạo ra bởi các chương trình tự động, không phải người dùng thật. Mỗi bot được lập trình để thực hiện các tác vụ lặp đi lặp lại như truy cập URL, đọc nội dung trang, điền form, click vào quảng cáo hoặc gửi request đến server với tốc độ nhanh hơn con người hàng chục đến hàng trăm lần và không cần nghỉ ngơi.

Cơ chế hoạt động theo mục tiêu của bot:

- Bot tốt (ví dụ: search engine bots): Quét URL, đọc nội dung, theo dõi liên kết và lập chỉ mục cho công cụ tìm kiếm.

- Bot xấu (ví dụ: web scrapers, ad fraud bots): Trích xuất dữ liệu, giả lập hành vi người dùng, tạo lượt click/hiển thị ảo, thường ẩn danh và né các biện pháp phòng chống bot.

- Bot trung lập: Hoạt động tùy mục đích, có thể hỗ trợ quản lý website hoặc giám sát, nhưng cũng có thể tốn tài nguyên và ảnh hưởng dữ liệu nếu không kiểm soát.

Hai mặt đối lập của bot traffic trong cuộc chơi SEO

Bot traffic không hoàn toàn xấu nhưng cũng không hoàn toàn vô hại, đặc biệt trong SEO. Hiểu rõ hai mặt tích cực và tiêu cực của bot giúp bạn tận dụng giá trị và hạn chế rủi ro. Nhiều doanh nghiệp chỉ nhìn vào con số traffic tăng vọt nhưng không phân biệt được traffic thực hay traffic bot, dẫn đến quyết định SEO hoặc marketing thiếu chính xác .Để hiểu rõ, ta có thể phân loại bot traffic theo hai mặt: tích cực và tiêu cực.

1. Mặt tích cực

Nếu không có sự hoạt động của các bot tốt, website của bạn sẽ không xuất hiện trên công cụ tìm kiếm, không được giám sát khi gặp sự cố và không được phân phối nội dung đến đúng đối tượng. Dưới đây là những giá trị mà bot traffic tích cực mang lại:

- Tăng khả năng hiển thị trên công cụ tìm kiếm: Search engine bots chính là "cầu nối" duy nhất giữa nội dung của bạn và hàng tỷ lượt tìm kiếm mỗi ngày. Nếu bot không crawl được trang của bạn do lỗi robots.txt, cấu trúc URL sai hoặc tốc độ tải chậm, trang đó đơn giản là không tồn tại trong mắt Google, bất kể nội dung có tốt đến đâu.

- Phát hiện lỗi kỹ thuật SEO kịp thời: Các công cụ SEO như Ahrefs, Semrush, Screaming Frog vận hành bot để crawl và phân tích cấu trúc website. Chúng phát hiện broken links, lỗi redirect, trang thiếu meta description, cấu trúc heading sai. Đây là những vấn đề mà nếu không có bot crawl định kỳ, bạn có thể không biết cho đến khi thứ hạng đã tụt.

- Đảm bảo uptime và hiệu suất kỹ thuật: Monitoring bots kiểm tra website của bạn liên tục, thường là mỗi 1 - 5 phút. Khi server gặp sự cố, bạn được cảnh báo ngay lập tức thay vì phát hiện ra vài giờ sau khi hàng trăm khách hàng đã gặp lỗi 503. Với SEO, downtime kéo dài là tín hiệu tiêu cực, monitoring bots giúp bạn phản ứng trước khi thiệt hại lan rộng.

- Hỗ trợ phân phối nội dung và xây dựng link tự nhiên: Feed bots và social media crawlers giúp nội dung của bạn lan rộng đến các nền tảng tổng hợp, ứng dụng đọc tin và mạng xã hội, mỗi lần được đề cập và chia sẻ đều là cơ hội tạo ra backlink tự nhiên hoặc traffic giới thiệu (referral traffic), hai yếu tố có giá trị cao trong chiến lược SEO dài hạn.

- Cung cấp benchmark cạnh tranh khách quan: Khi bot của các công cụ SEO crawl cả website của bạn lẫn đối thủ, dữ liệu tổng hợp này cho phép bạn so sánh domain authority, profile backlink và mật độ từ khóa một cách khách quan.

2. Mặt tiêu cực

Ngược lại, bot xấu có thể gây ra những tác hại đáng kể cho SEO, dữ liệu website và ngân sách marketing nếu không kiểm soát. Chúng thường ẩn danh, hoạt động tự động và lặp đi lặp lại, khiến doanh nghiệp khó phân biệt với người dùng thật. Cụ thể:

- Làm méo dữ liệu analytics và phá vỡ quyết định SEO: Đây là tác hại âm thầm nhưng có hệ quả lớn nhất về mặt chiến lược. Khi bot traffic lẫn vào trong dữ liệu analytics, hành vi người dùng bị bóp méo thể hiện qua bounce rate tăng bất thường, dữ liệu nguồn bị nhiễu,....

- Tiêu thụ crawl budget của Googlebot: Crawl budget là số lượng trang mà Googlebot sẵn sàng crawl trên website của bạn trong một khoảng thời gian nhất định. Khi bot xấu liên tục gửi request đến website, chúng tạo ra tải server không cần thiết. Khi server phản hồi chậm hoặc trả về lỗi do quá tải, Googlebot nhận tín hiệu rằng website đang có vấn đề về kỹ thuật và giảm tần suất crawl.

- Tăng tải server và ảnh hưởng trải nghiệm người dùng: Bot xấu truy cập với tần suất cao, pattern lặp lại, chiếm băng thông, CPU và dung lượng server. Hậu quả là website chậm, người dùng thật trải nghiệm kém, ảnh hưởng trực tiếp đến SEO và tỷ lệ chuyển đổi.

Cách nhận biết website đang bị tấn công bởi traffic bot xấu

Traffic bot xấu thường ẩn mình trong dữ liệu truy cập và rất khó phát hiện nếu chỉ nhìn vào con số tổng thể. Tuy nhiên, có một số dấu hiệu rõ ràng cho thấy website của bạn đang bị bot traffic ảnh hưởng, từ đó có thể thực hiện biện pháp kiểm soát kịp thời.

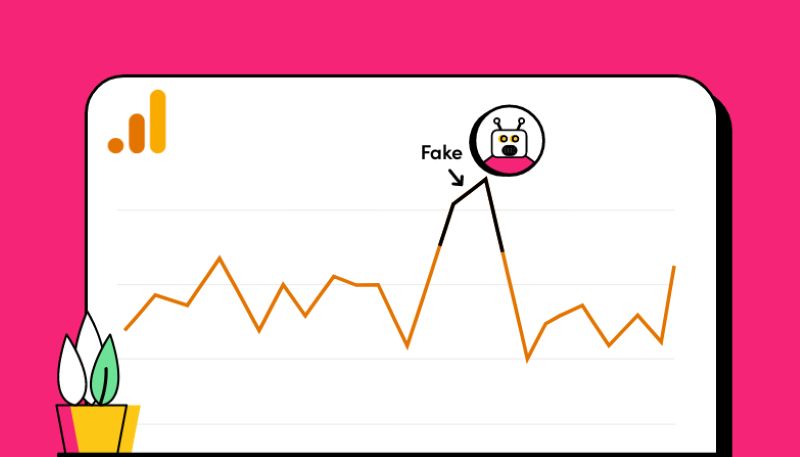

- Traffic tăng bất thường: Một trong những dấu hiệu đầu tiên là lượng truy cập tăng đột biến mà không đi kèm với chiến dịch quảng cáo hay sự kiện marketing nào. Các lưu lượng truy cập bot xấu có thể gửi hàng nghìn request trong thời gian ngắn, khiến biểu đồ traffic trên Google Analytics hoặc các công cụ thống kê nhìn “đẹp” nhưng ảo. Lưu ý rằng traffic tăng từ bot thường không mang lại chuyển đổi, do đó nếu traffic tăng nhưng doanh thu, lead hoặc form submission không thay đổi, đây là dấu hiệu rõ ràng của bot xấu.

- Tỷ lệ thoát cao: Bot xấu thường truy cập một trang duy nhất hoặc một số trang cố định, sau đó rời đi mà không thực hiện hành động nào khác. Điều này dẫn đến tỷ lệ thoát (bounce rate) cực cao, thậm chí 100% cho một số phiên. Nếu tỷ lệ thoát tăng đột biến mà không có lý do hợp lý về nội dung hoặc chiến dịch quảng cáo, rất có thể website đang bị bot xấu tấn công.

- Thời gian on-site cực thấp: Các traffic bot thường không đọc nội dung, không tương tác với video hay các liên kết nội bộ, do đó các phiên truy cập thường kéo dài vài giây hoặc vài phần trăm phút. Khi so sánh với hành vi người dùng thật, thời gian on-site quá thấp là một cảnh báo về traffic không tự nhiên.

- Nguồn truy cập lạ: Bot xấu thường xuất hiện từ địa chỉ IP lạ hoặc các quốc gia không liên quan đến đối tượng mục tiêu. Trong báo cáo traffic, bạn có thể thấy nguồn giới thiệu (referral) không quen thuộc hoặc các trang web giới thiệu không hợp lý, đôi khi là những tên miền spam. Các traffic này thường không mang lại giá trị thực và chỉ làm sai lệch dữ liệu phân tích.

- Hành vi bất thường: Bot xấu thường thể hiện các hành vi bất thường như click liên tục vào quảng cáo, điền form hàng loạt với nội dung spam, hoặc truy cập vào các URL ẩn/không tồn tại. Một số bot còn giả lập hành vi người dùng thật nhưng với pattern lặp lại, tốc độ không tự nhiên. Việc quan sát các hành vi này giúp phân biệt bot với người dùng thật và áp dụng các biện pháp chặn bot hiệu quả.

Hướng dẫn kiểm tra bot traffic chính xác

Bot traffic không chỉ làm méo dữ liệu, mà còn ảnh hưởng trực tiếp đến SEO, hiệu suất website và ngân sách quảng cáo. Kiểm tra bot traffic định kỳ giúp bạn nhận diện các phiên truy cập ảo, đánh giá mức độ ảnh hưởng và triển khai biện pháp phòng ngừa kịp thời. Dưới đây là 3 phương pháp kiểm tra, bạn có thể áp dụng một hoặc kết hợp cả ba tùy theo quy mô và mức độ ưu tiên của website.

1. Kiểm tra qua Google Analytics

Sử dụng tài khoản Google Analytics (GA) là cách phổ biến nhất để giám sát lưu lượng website, đồng thời cung cấp các chỉ số giúp phân biệt traffic thực và traffic bot. Dù không phải công cụ chuyên biệt về bot detection, GA vẫn là điểm khởi đầu phù hợp với hầu hết doanh nghiệp nhờ tính dễ tiếp cận và khả năng phát hiện các dấu hiệu bất thường ở cấp độ cơ bản. Các bước kiểm tra bot traffic trong GA gồm:

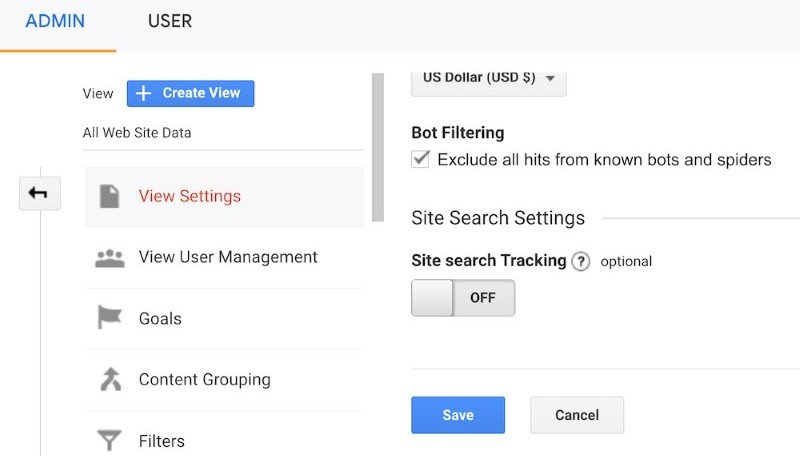

Bước 1: Kích hoạt bộ lọc bot chuẩn

Bạn vào Admin → View Settings → Bot Filtering, đánh dấu chọn “Exclude all hits from known bots and spiders”. Khi bộ lọc này được kích hoạt, các lượt truy cập từ bot và spider phổ biến sẽ không được tính vào dữ liệu, giúp bạn có cái nhìn chính xác hơn về lượng traffic thực từ người dùng.

Bước 2: Quan sát các chỉ số bất thường

Sau khi bật bộ lọc, bạn nên quan sát các chỉ số cơ bản trong Google Analytics để nhận diện traffic không tự nhiên:

- Lượng truy cập tăng đột biến không gắn với bất kỳ chiến dịch marketing hay sự kiện cụ thể nào, đặc biệt khi tăng trong đêm hoặc cuối tuần.

- Bounce rate tăng bất thường lên trên 90%, đây là dấu hiệu cho thấy phần lớn phiên truy cập trên website của bạn không có bất kỳ tương tác nào.

- Thời gian on-site cực thấp bởi vì bot không đọc nội dung, không cuộn trang, không click link.

- Tỷ lệ chuyển đổi giảm đột ngột dù traffic không đổi hoặc tăng, dấu hiệu traffic mới đến không phải người dùng thật

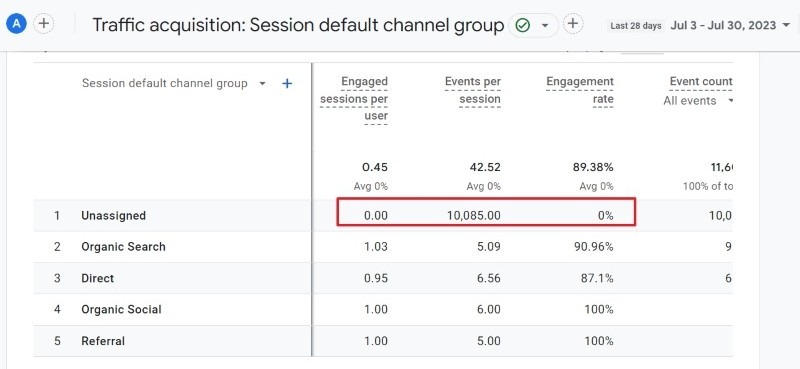

Bước 3: Phân tích nguồn truy cập

Bạn kiểm tra các nguồn traffic trong phần Acquisition → All Traffic → Channels để phát hiện nguồn lạ hoặc không liên quan đến đối tượng mục tiêu. Một số dấu hiệu cần chú ý:

- Referral traffic đến từ các tên miền hoàn toàn không liên quan đến lĩnh vực của bạn, đặc biệt là các tên miền có đuôi lạ hoặc chứa ký tự ngẫu nhiên.

- Direct traffic tăng vọt bất thường, đây thường là nơi nhiều bot ẩn náu sau khi không khai báo referrer

- Traffic đến từ các quốc gia không thuộc đối tượng mục tiêu với tỷ lệ bounce gần 100%.

Bước 4: Sử dụng báo cáo hành vi

Trong Google Analytics, bạn vào báo cáo Behavior → Site Content → All Pages để quan sát pattern truy cập bất thường. Những tín hiệu đáng ngờ bao gồm:

- Một URL cụ thể nhận được lượng truy cập bất thường cao so với các trang khác, đặc biệt nếu đó là trang ít giá trị với người dùng thật (trang admin, trang cảm ơn, trang 404)

- Thời gian trung bình trên trang gần bằng 0 với hàng trăm lượt xem: Không có luồng điều hướng tự nhiên, các traffic bot thường truy cập thẳng vào URL mà không đến từ trang chủ hay đi sâu hơn vào site.

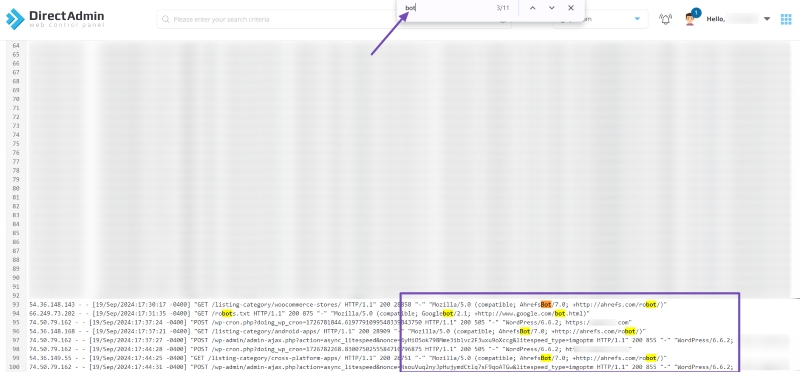

2. Kiểm tra log server

Bên cạnh Google Analytics, log server là nguồn dữ liệu trực tiếp và đáng tin cậy để phát hiện bot traffic. Log server ghi lại tất cả request gửi đến website, bao gồm cả IP, User-Agent, thời gian truy cập, URL truy cập và mã trạng thái HTTP. Nhờ đó, bạn có thể quan sát chi tiết các phiên truy cập mà analytics có thể bỏ sót, đặc biệt là bot tinh vi giả lập hành vi người dùng.

Các dấu hiệu cần chú ý khi phân tích log:

- IP gửi request quá nhiều lần trong thời gian ngắn.

- Pattern truy cập lặp lại một cách cơ học, không giống hành vi người dùng thật.

- Request đến các URL ít hoặc không bao giờ được truy cập bởi người dùng.

- IP hoặc quốc gia lạ không thuộc đối tượng mục tiêu.

Cách truy cập log server:

- Nếu website chạy trên Apache hoặc Nginx, log thường nằm tại /var/log/apache2/access.log hoặc /var/log/nginx/access.log.

- Đối với trường hợp hosting thông thường (cPanel, Plesk), bạn có thể tìm thấy file log trong mục Logs hoặc Metrics trên giao diện quản trị.

- Các công cụ như GoAccess hoặc AWStats có thể giúp bạn visualize log dạng raw thành báo cáo dễ đọc hơn mà không cần kỹ năng lập trình.

3. Sử dụng công cụ hỗ trợ

Ngoài Google Analytics và log server, các công cụ chuyên dụng về bot management giúp bạn phát hiện và phân loại bot một cách tự động, chính xác hơn, đặc biệt là các bot tinh vi mà phương pháp truyền thống khó nhận diện.

Điểm mạnh của nhóm công cụ này là khả năng phân tích hành vi thực thời gian thực, không chỉ dựa vào IP hay User-Agent (những thứ bot có thể giả mạo), mà còn dựa vào chuyển động chuột, tốc độ gõ phím, độ trễ giữa các thao tác, fingerprint trình duyệt và hàng chục tín hiệu hành vi khác mà bot rất khó tái tạo hoàn hảo.

| Công cụ | Phân khúc phù hợp | Điểm mạnh |

| Cloudflare Bot Management | Doanh nghiệp vừa và lớn. | Tích hợp sẵn vào CDN, xử lý bot trước khi request đến server. |

| CHEQ | Marketing và Ad fraud | Chuyên sâu về bảo vệ ngân sách quảng cáo và click fraud. |

| ClickCease | SMBs chạy Google/Facebook Ads. | Chuyên biệt cho click fraud, giao diện đơn giản. |

| Imperva Bot Protection | Enterprise | Phân tích hành vi nâng cao, hỗ trợ API protection. |

| DataDome | E-commerce và publisher. | Phát hiện bot thời gian thực, không ảnh hưởng UX người dùng thật. |

| Arkose Labs | Nền tảng có rủi ro account takeover. | Kết hợp CAPTCHA thích ứng với phân tích rủi ro. |

Giải pháp quản lý và ngăn chặn bot traffic hiệu quả

Bot traffic có thể gây ảnh hưởng nghiêm trọng đến dữ liệu, SEO và ngân sách marketing nếu không được quản lý. Dưới đây là các biện pháp phòng ngừa và chặn bot traffic từ đơn giản đến chuyên sâu, giúp bạn chủ động bảo vệ website.

- Sử dụng file Robots.txt: Robots.txt là tuyến phòng thủ đầu tiên và cũng là biện pháp dễ triển khai nhất. Bạn chỉ cần tạo một file văn bản thuần và đặt tại thư mục gốc của website (ví dụ: yourdomain.com/robots.txt). File này hướng dẫn bot về những phần nào của website được phép crawl và những phần nào không, từ đó giảm lưu lượng bot không mong muốn, đặc biệt là các bot cơ bản và scrapers. Đây là giải pháp không yêu cầu kỹ năng lập trình hay công cụ bổ sung.

- Sử dụng firewall, CDN: Firewall hoặc CDN (Content Delivery Network) giúp lọc và giám sát lưu lượng truy cập trước khi đến server. Nhiều dịch vụ, như Cloudflare hoặc WAF, có tính năng nhận diện và chặn bot tự động, bảo vệ website khỏi DDoS, ad fraud và các bot tinh vi khác mà không cần can thiệp thủ công.

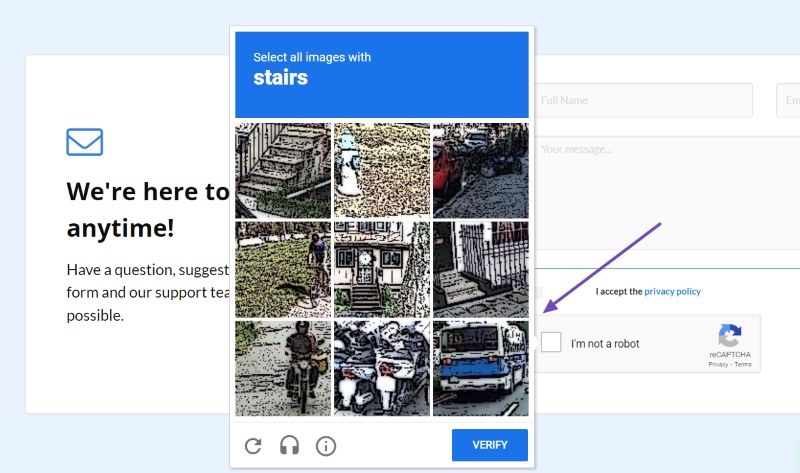

- Cài đặt CAPTCHA: CAPTCHA là một lớp bảo vệ trực tiếp trên các form, đăng ký, bình luận hoặc giao dịch quan trọng. Khi một bot cố gắng gửi request tự động, CAPTCHA sẽ yêu cầu xác thực mà chỉ con người mới thực hiện được. Đây là biện pháp hiệu quả để ngăn spam bots, form bots và các hành vi tự động gây rác dữ liệu.

- Giới hạn request (Rate Limiting): Rate limiting là kỹ thuật kiểm soát tần suất request từ một nguồn trong một khoảng thời gian nhất định. Khi một IP gửi quá nhiều request, server sẽ trả về mã lỗi 429 Too Many Requests và tạm thời từ chối các request tiếp theo. Đây là giải pháp hiệu quả chống scrapers, credential stuffing bots, DDoS bots, ngay cả khi chưa nhận diện chính xác bot.

- Chặn theo IP hoặc quốc gia: Khi phân tích log server hoặc báo cáo bot, bạn có thể phát hiện các địa chỉ IP hoặc dải IP (subnet) đang tạo ra lưu lượng bất thường. Chặn bot traffic trực tiếp những IP này sẽ ngăn bot gửi thêm request đến server. Bạn có thể thực hiện chặn ở nhiều cấp độ: trên server (.htaccess, Nginx), qua CDN/firewall (Cloudflare, WAF), trên hosting panel (cPanel, Plesk) hoặc chặn theo quốc gia nếu website chỉ phục vụ một khu vực cụ thể.

- Sử dụng dịch vụ ngăn chặn bot chuyên nghiệp: Các dịch vụ chuyên dụng như Cloudflare Bot Management, Imperva Bot Protection, PerimeterX giúp nhận diện bot tinh vi theo hành vi, IP, User-Agent và pattern truy cập, tự động phân loại và block bot xấu, đồng thời báo cáo chi tiết về lưu lượng bot, hỗ trợ tối ưu SEO, dữ liệu và ngân sách quảng cáo.

- Cập nhật tính năng bảo mật thường xuyên: Bot traffic và các kỹ thuật tấn công luôn thay đổi liên tục. Vì vậy, cập nhật phần mềm, plugin, firewall, CDN và các giải pháp bảo mật định kỳ là cần thiết để duy trì hiệu quả phòng chống bot. Việc này giúp website luôn được bảo vệ trước các mối đe dọa mới và hạn chế các rủi ro từ bot xấu.

Một số câu hỏi thường gặp về lưu lượng truy cập bot

Bot traffic là một hiện tượng phổ biến mà nhiều chủ website gặp phải, nhưng không phải ai cũng hiểu rõ tác động và cách quản lý chúng. Dưới đầy là những câu hỏi thường gặp, giúp bạn nhận diện, phân biệt và kiểm soát bot traffic hiệu quả, từ đó bảo vệ dữ liệu, SEO và ngân sách marketing của website.

1. Bot traffic có làm tăng thứ hạng SEO cho website không?

Bot traffic không trực tiếp giúp tăng thứ hạng SEO. Chỉ những bot hợp pháp như search engine bots mới ảnh hưởng tích cực đến SEO bằng cách crawl và lập chỉ mục nội dung. Ngược lại, các traffic bot xấu hay spam không mang giá trị SEO, thậm chí còn làm méo dữ liệu, gây hiểu lầm khi phân tích traffic và đánh giá hiệu quả chiến lược SEO. Do đó, tăng lượng truy cập nhờ bot không đồng nghĩa với cải thiện thứ hạng trên công cụ tìm kiếm.

2. Làm thế nào để phân biệt người dùng thật và bot trên Google Analytics 4 (GA4)?

Trên GA4, bạn có thể nhận biết bot traffic thông qua các chỉ số bất thường như bounce rate quá cao, thời gian on-site cực thấp, nguồn truy cập lạ hoặc số lượng session tăng đột biến. GA4 cũng cung cấp tùy chọn Bot Filtering (Admin → Data Settings → Data Filters → Bot Traffic), giúp loại bỏ các lượt truy cập từ bot đã biết. Kết hợp quan sát các pattern truy cập và log server sẽ giúp bạn phân biệt chính xác hơn giữa người dùng thật và bot.

3. Có nên chặn hoàn toàn bot traffic không?

Không nên chặn toàn bộ bot traffic vì một số bot, đặc biệt là search engine bots, monitoring bots hay social media crawlers, mang lại giá trị quan trọng cho website. Chặn traffic bot hợp pháp sẽ ảnh hưởng đến SEO, khả năng giám sát uptime và phân phối nội dung. Giải pháp tối ưu là phân loại bot và chỉ chặn những bot xấu, spam hoặc gây hại.

4. Tại sao website mới lập, chưa có nội dung lại được nhiều bot truy cập?

Website mới lập thường bị bot truy cập vì nhiều lý do: search engine bots crawl trang để lập chỉ mục từ khi website vừa xuất hiện, các bot scrapers thu thập dữ liệu mặc định từ các domain mới hoặc các social media crawlers thu thập thông tin để hiển thị preview khi link được chia sẻ. Đây là hiện tượng bình thường, không đồng nghĩa với traffic người dùng thật, nhưng cần theo dõi để phân biệt bot hợp pháp và bot xấu.

5. File Robots.txt có ngăn chặn được 100% bot traffic xấu không?

Không, file Robots.txt chỉ hướng dẫn bot tuân thủ các quy tắc crawl; các bot xấu tinh vi thường phớt lờ file này và vẫn truy cập nội dung. Robots.txt hiệu quả với bot hợp pháp, scrapers cơ bản và giúp giảm bớt lưu lượng không mong muốn, nhưng không thể ngăn 100% bot xấu. Các biện pháp bổ sung như CAPTCHA, rate limiting, firewall/CDN hoặc dịch vụ chuyên nghiệp vẫn cần thiết để bảo vệ website.

6. Bot traffic có phải là traffic ảo không? Khoảng bao nhiêu % bot traffic là bình thường?

Bot traffic được gọi là traffic ảo khi nó không đến từ người dùng thật và không mang giá trị tương tác. Tuy nhiên, một phần bot traffic là hợp pháp và cần thiết cho SEO, giám sát, hoặc phân phối nội dung. Theo báo cáo từ Imperva, trung bình khoảng 40 - 50% tổng traffic internet là bot, trong đó khoảng 30% là bot xấu. Con số này khác nhau tùy ngành và quy mô website, vì vậy điều quan trọng là phân loại bot thay vì loại bỏ hoàn toàn mọi traffic tự động.

Qua bài viết của Phương Nam Vina, có thể thấy bot traffic là một phần không thể tránh khỏi trong lưu lượng truy cập website, mang cả cơ hội lẫn rủi ro. Những bot tốt giúp website được lập chỉ mục, giám sát kỹ thuật và phân phối nội dung hiệu quả, trong khi bot xấu có thể làm méo dữ liệu, tốn băng thông và ảnh hưởng trực tiếp đến ngân sách marketing. Hiểu rõ các loại bot, cách nhận diện và triển khai các biện pháp quản lý phù hợp từ robots.txt, CAPTCHA, firewall/CDN đến rate limiting hay các dịch vụ chuyên nghiệp sẽ giúp bạn tối ưu SEO, bảo vệ dữ liệu và kiểm soát ngân sách. Ngăn chặn bot traffic không chỉ là phòng ngừa rủi ro mà còn là chiến lược thông minh để duy trì hiệu quả lâu dài cho website và doanh nghiệp.

Tham khảo thêm:

![]() 18 cách tăng traffic website hiệu quả, tiết kiệm chi phí

18 cách tăng traffic website hiệu quả, tiết kiệm chi phí